Tác giả gốc: Mohamed Baioumy Alex Cheema

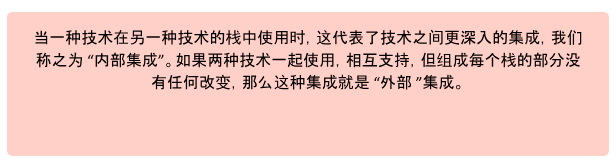

Biên soạn gốc: BeWater

Do độ dài của báo cáo đầy đủ, chúng tôi đã chia nó thành hai phần để xuất bản. Bài viết này là bài viết đầu tiên, chủ yếu mô tả khung cốt lõi của AI x Crypto, các ví dụ cụ thể, cơ hội cho các nhà xây dựng, v.v. Nếu bạn muốn xem toàn văn bản dịch, vui lòng bấm vào đâyliên kết。

1. Giới thiệu

Trí tuệ nhân tạo (AI) sẽ gây ra những thay đổi xã hội chưa từng có.

Khi AI tiến bộ nhanh chóng và tạo ra những khả năng mới trên mọi tầng lớp xã hội, nó chắc chắn sẽ gây ra sự gián đoạn kinh tế trên diện rộng. Ngành công nghiệp tiền điện tử cũng không ngoại lệ. Chúng tôi đã quan sát thấy ba cuộc tấn công DeFi lớn trong tuần đầu tiên của năm 2024, gây rủi ro cho 76 tỷ USD giao thức DeFi. Tận dụng AI, chúng ta có thể kiểm tra các hợp đồng thông minh để tìm các lỗ hổng bảo mật và tích hợp các lớp bảo mật dựa trên AI vào chuỗi khối.

Hạn chế của AI là kẻ xấu có thể lạm dụng các mô hình mạnh mẽ, bằng chứng là sự lan truyền của các deepfake độc hại. Rất may, những tiến bộ khác nhau trong mật mã sẽ mang lại những khả năng mới cho các mô hình AI, làm phong phú thêm đáng kể ngành công nghiệp AI đồng thời giải quyết một số thiếu sót nghiêm trọng.

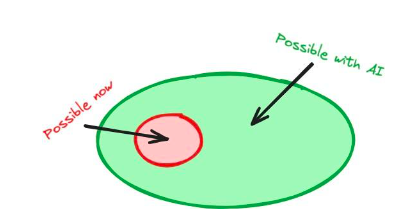

Sự hội tụ của AI và tiền điện tử (Crypto) sẽ tạo ra vô số dự án đáng chú ý. Một số dự án này sẽ cung cấp giải pháp cho các vấn đề trên, trong khi những dự án khác sẽ kết hợp AI và Crypto một cách hời hợt nhưng không mang lại lợi ích thực sự.

Trong báo cáo này, chúng tôi sẽ giới thiệu khung khái niệm, ví dụ cụ thể và hiểu biết sâu sắc để giúp bạn hiểu về quá khứ, hiện tại và tương lai của lĩnh vực này.

2. Khung cốt lõi của AI x Crypto

Trong phần này, chúng tôi sẽ giới thiệu một số công cụ thiết thực để giúp bạn phân tích các dự án AI x Crypto chi tiết hơn

2.1 Dự án AI (công nghệ trí tuệ nhân tạo) x Crypto (công nghệ mã hóa) là gì?

Hãy xem xét một số ví dụ về các dự án sử dụng cả tiền điện tử và AI, sau đó thảo luận xem chúng có thực sự là dự án AI x Crypto hay không.

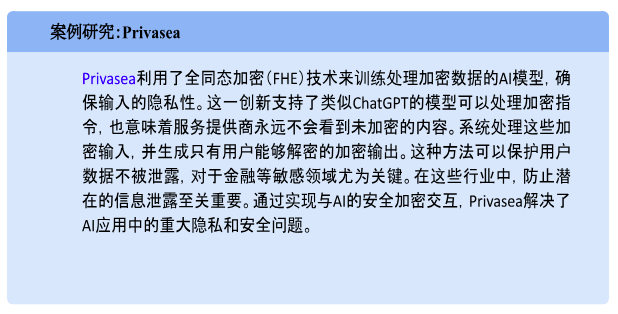

Trường hợp này cho thấy cách mật mã có thể trợ giúp và cải thiện một sản phẩm AI - sử dụng các phương pháp mật mã để thay đổi cách đào tạo AI. Điều này dẫn đến một sản phẩm không thể đạt được nếu chỉ sử dụng công nghệ AI: một mô hình có thể chấp nhận các hướng dẫn mật mã.

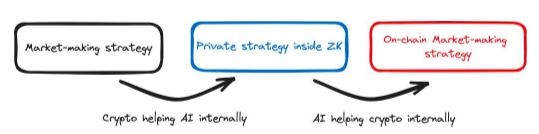

Hình 1: Sử dụng mật mã để thực hiện các thay đổi nội bộ đối với ngăn xếp AI có thể dẫn đến các khả năng mới. Ví dụ: FHE cho phép chúng tôi sử dụng các hướng dẫn mật mã

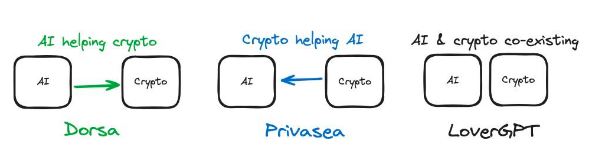

Trong trường hợp này, công nghệ AI được sử dụng để cải thiện các sản phẩm tiền điện tử—ngược lại với những gì chúng ta đã thảo luận trước đó. Dorsa cung cấp mô hình AI giúp quá trình tạo hợp đồng thông minh an toàn nhanh hơn và rẻ hơn. Mặc dù nằm ngoài chuỗi nhưng việc sử dụng các mô hình AI vẫn giúp ích cho các dự án tiền điện tử: hợp đồng thông minh thường là cốt lõi của các giải pháp dự án tiền điện tử.

Khả năng AI của Dorsa có thể ngăn chặn các vụ hack trong tương lai bằng cách phát hiện các lỗ hổng mà con người quên kiểm tra. Tuy nhiên, ví dụ cụ thể này không tận dụng AI để cung cấp cho các sản phẩm tiền điện tử khả năng thực hiện điều mà trước đây chúng không thể làm – viết các hợp đồng thông minh an toàn. AI của Dorsa chỉ giúp quá trình này tốt hơn và nhanh hơn. Tuy nhiên, đây là một ví dụ về (mô hình) công nghệ AI cải tiến các sản phẩm tiền điện tử (hợp đồng thông minh).

LoverGPT không phải là một ví dụ về Crypto x AI. Chúng tôi đã chứng minh rằng AI có thể giúp cải thiện kho tiền điện tử và ngược lại, điều này được minh họa bằng ví dụ của Privasea và Dorsa. Tuy nhiên, trong trường hợp của LoverGPT, phần mã hóa và phần AI không tương tác với nhau, chúng chỉ cùng tồn tại trong sản phẩm. Để một dự án được coi là dự án AI x Crypto, việc AI và Crypto đóng góp cho cùng một sản phẩm hoặc giải pháp là chưa đủ — những công nghệ này phải được kết hợp với nhau để tạo ra giải pháp.

Tiền điện tử và AI là những công nghệ có thể được kết hợp trực tiếp để tạo ra các giải pháp tốt hơn. Sử dụng chúng cùng nhau có thể làm cho nhau làm việc tốt hơn trong dự án tổng thể. Chỉ những dự án liên quan đến sức mạnh tổng hợp giữa các công nghệ này mới được phân loại là dự án AI X Crypto.

2.2 AI và tiền điện tử thúc đẩy lẫn nhau như thế nào

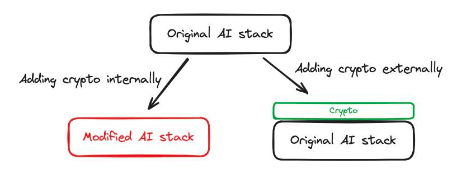

Hình 2: Cách kết hợp AI và tiền điện tử trong 3 sản phẩm khác nhau

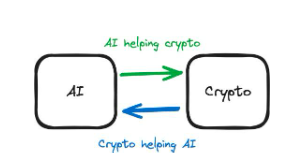

Hãy xem lại nghiên cứu điển hình trước đó. Trong Privasea, FHE hoặc mật mã, được sử dụng để tạo các mô hình AI có thể chấp nhận đầu vào được mã hóa. Vì vậy, chúng tôi đang sử dụng giải pháp Crypto để cải thiện quá trình đào tạo AI, vì vậy Crypto đang giúp đỡ AI. Ở Dorsa, các mô hình AI được sử dụng để đánh giá tính bảo mật của hợp đồng thông minh. Các giải pháp AI được sử dụng để cải thiện các sản phẩm tiền điện tử, do đó, AI đang giúp đỡ tiền điện tử. Điều này đưa chúng ta đến một khía cạnh quan trọng khi đánh giá các dự án tại AI

Câu hỏi đơn giản này có thể giúp chúng tôi khám phá các khía cạnh quan trọng trong trường hợp sử dụng hiện tại của chúng tôi, tức là vấn đề chính cần giải quyết là gì? Trong trường hợp của Dorsa, kết quả mong muốn là một hợp đồng thông minh an toàn. Điều này có thể được thực hiện bởi một nhà phát triển lành nghề và Dorsa tình cờ tận dụng AI để làm cho quá trình này hiệu quả hơn. Tuy nhiên, về cơ bản, chúng tôi chỉ quan tâm đến tính bảo mật của hợp đồng thông minh. Khi các câu hỏi chính đã rõ ràng, chúng ta có thể xác định liệu AI đang giúp đỡ tiền điện tử hay tiền điện tử đang giúp đỡ AI. Trong một số trường hợp, không có sự tương tác có ý nghĩa nào giữa cả hai (ví dụ: LoverGPT).

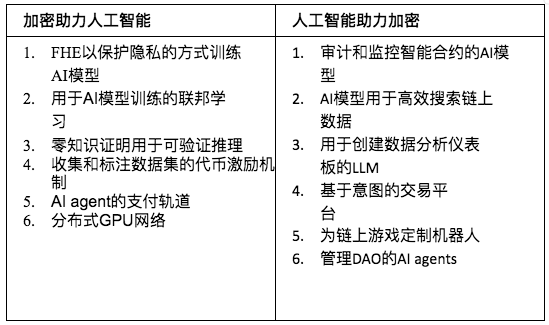

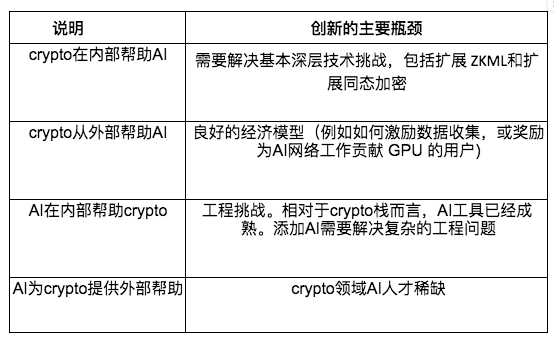

Bảng dưới đây cung cấp một vài ví dụ trong mỗi loại.

Bảng 1: Cách kết hợp tiền điện tử và AI

Bạn có thể tìm thấy hơn 150 thư mục dự án AI x Crypto trong phần phụ lục. Nếu chúng tôi bỏ sót điều gì hoặc nếu bạn có bất kỳ phản hồi nào, vui lòngkết nốichúng ta!

2.2.1 Tóm tắt

Cả AI và Crypto đều có khả năng hỗ trợ công nghệ khác để đạt được mục tiêu của mình. Khi đánh giá một dự án, điều quan trọng là phải hiểu xem cốt lõi của nó là sản phẩm AI hay sản phẩm tiền điện tử.

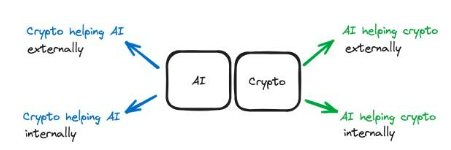

Hình 3: Giải thích sự khác biệt

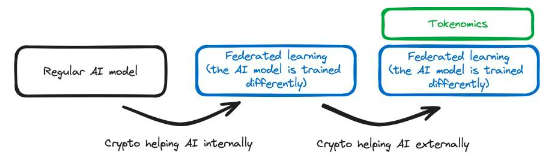

2.3 Hỗ trợ bên trong và bên ngoài

Hãy lấy một ví dụ về việc tiền điện tử hỗ trợ AI. Khi bộ công nghệ cụ thể tạo nên AI thay đổi, toàn bộ khả năng của giải pháp AI cũng thay đổi. Bộ sưu tập công nghệ này được gọi là ngăn xếp. Nhóm AI bao gồm các ý tưởng toán học và thuật toán tạo nên tất cả các khía cạnh của AI. Các kỹ thuật cụ thể được sử dụng để xử lý dữ liệu huấn luyện, mô hình huấn luyện và suy luận mô hình đều là một phần của ngăn xếp.

Trong ngăn xếp, có những kết nối sâu sắc giữa các bộ phận khác nhau—cách kết hợp các công nghệ cụ thể sẽ xác định chức năng của ngăn xếp. Do đó, việc thay đổi ngăn xếp tương đương với việc thay đổi những gì toàn bộ công nghệ có thể đạt được. Việc đưa công nghệ mới vào kho có thể tạo ra các khả năng công nghệ mới – Ethereum đã bổ sung công nghệ mới vào kho tiền điện tử của mình để biến các hợp đồng thông minh thành hiện thực. Tương tự như vậy, những thay đổi đối với ngăn xếp cũng có thể cho phép các nhà phát triển bỏ qua các vấn đề trước đây được cho là cố hữu của công nghệ - những thay đổi mà Polygon thực hiện đối với ngăn xếp tiền điện tử Ethereum đã cho phép họ giảm phí giao dịch xuống mức mà trước đây được cho là không thể.

Hỗ trợ nội bộ:Cryptozoology có thể được sử dụng để thực hiện các thay đổi nội bộ đối với nhóm AI, chẳng hạn như thay đổi phương tiện kỹ thuật mà mô hình được đào tạo. Chúng ta có thể đưa công nghệ FHE vào ngăn xếp trí tuệ nhân tạo, Privasea là một ví dụ, một phần mã hóa được tích hợp trực tiếp vào ngăn xếp AI, tạo thành ngăn xếp AI được sửa đổi.

Hỗ trợ bên ngoài:Tiền điện tử được sử dụng để hỗ trợ chức năng dựa trên AI mà không yêu cầu sửa đổi ngăn xếp AI.Bittensorlà một ví dụ khuyến khích người dùng đóng góp dữ liệu – dữ liệu có thể được sử dụng để đào tạo các mô hình AI. Trong trường hợp này, không có gì thay đổi về cách đào tạo hoặc sử dụng mô hình; không có gì thay đổi trong ngăn xếp AI. Tuy nhiên, trong mạng Bittensor, việc sử dụng các ưu đãi kinh tế giúp ngăn xếp AI đạt được mục đích của nó tốt hơn.

Hình 4: Minh họa cuộc thảo luận trước đó

Tương tự, AI cũng có thể cung cấp trợ giúp nội bộ hoặc bên ngoài cho Crypto:

Hỗ trợ nội bộ:Công nghệ AI được sử dụng bên trong ngăn xếp tiền điện tử. AI hoạt động trên chuỗi và được kết nối trực tiếp với các phần của ngăn xếp tiền điện tử. Ví dụ: các tác nhân AI trên chuỗi quản lý DAO. AI này không chỉ hỗ trợ ngăn xếp mật mã. Nó là một phần không thể thiếu của nhóm công nghệ và được nhúng sâu vào nhóm công nghệ để cho phép DAO hoạt động bình thường.

Hỗ trợ bên ngoài:AI cung cấp hỗ trợ bên ngoài cho ngăn xếp tiền điện tử. AI được sử dụng để hỗ trợ ngăn xếp tiền điện tử mà không thực hiện các thay đổi nội bộ đối với nó. Các nền tảng như Dorsa sử dụng mô hình AI để bảo đảm hợp đồng thông minh. AI nằm ngoài chuỗi và là một công cụ bên ngoài được sử dụng để giúp quá trình viết hợp đồng thông minh an toàn nhanh hơn và rẻ hơn.

Hình 5: Đây là model nâng cấp, bao gồm sự khác biệt giữa hỗ trợ bên trong và hỗ trợ bên ngoài

Giai đoạn đầu tiên trong việc phân tích bất kỳ dự án AI x Crypto nào là xác định xem dự án đó thuộc loại nào.

2.4 Xác định điểm nghẽn

So với hỗ trợ bên ngoài, hỗ trợ nội bộ có đặc điểm tích hợp kỹ thuật sâu thường gặp nhiều khó khăn về mặt kỹ thuật hơn. Ví dụ: nếu chúng tôi muốn sửa đổi ngăn xếp AI bằng cách giới thiệu FHE hoặc bằng chứng không có kiến thức (ZKP), chúng tôi sẽ cần nhân viên kỹ thuật có chuyên môn đáng kể về cả mật mã và AI. Nhưng ít ai rơi vào ngã tư này. Những công ty này bao gồmModulus、EZKL、ZamaVàPrivasea。

Kết quả là, các công ty này đòi hỏi nguồn vốn đáng kể và nguồn nhân lực khan hiếm để phát triển các giải pháp của họ. Việc cho phép người dùng tích hợp trí tuệ nhân tạo vào hợp đồng thông minh cũng đòi hỏi kiến thức chuyên sâu;RitualVàOraNhững công ty như thế này phải giải quyết các vấn đề kỹ thuật phức tạp.

Ngược lại, hỗ trợ từ bên ngoài cũng có những hạn chế nhưng chúng thường ít phức tạp về mặt kỹ thuật hơn. Ví dụ: việc thêm khả năng thanh toán bằng tiền điện tử cho các tác nhân AI không yêu cầu chúng tôi phải sửa đổi mô hình nhiều. Nó tương đối dễ thực hiện. Mặc dù đối với các kỹ sư AI, việc xây dựng mộtPlugin ChatGPT để tạo ChatGPT từ DeFi LLamatrên trang webNhận số liệu thống kêKhông phức tạp về mặt kỹ thuật nhưng rất ít kỹ sư AI là thành viên của cộng đồng tiền điện tử. Mặc dù nhiệm vụ này không phức tạp về mặt kỹ thuật nhưng rất ít kỹ sư AI có quyền truy cập vào các công cụ này và nhiều người không biết về các khả năng này.

2.5 Tiện ích đo lường

Sẽ có những dự án tốt ở cả 4 hạng mục.

Nếu AI được tích hợp vào ngăn xếp tiền điện tử, các nhà phát triển hợp đồng thông minh sẽ có thể truy cập vào các mô hình AI trên chuỗi, tăng số lượng khả năng và có khả năng dẫn đến sự đổi mới rộng rãi. Điều tương tự cũng xảy ra với việc tích hợp tiền điện tử vào kho AI—sự hội tụ công nghệ sâu sẽ tạo ra những khả năng mới.

Hình 6: Việc thêm trí tuệ nhân tạo vào ngăn xếp tiền điện tử sẽ cung cấp cho các nhà phát triển những khả năng mới

Trong phạm vi AI cung cấp trợ giúp từ bên ngoài cho tiền điện tử, việc tích hợp AI có thể sẽ cải thiện các sản phẩm hiện có đồng thời tạo ra ít đột phá hơn và tạo ra ít khả năng hơn. Ví dụ, việc sử dụng các mô hình trí tuệ nhân tạo để viết hợp đồng thông minh có thể nhanh hơn và rẻ hơn trước đây, đồng thời cũng có thể cải thiện tính bảo mật nhưng khó có thể tạo ra các hợp đồng thông minh mà trước đây không thể thực hiện được. Điều tương tự cũng áp dụng cho tiền điện tử hỗ trợ AI từ bên ngoài - các ưu đãi mã thông báo có thể được sử dụng cho các ngăn xếp AI, nhưng bản thân điều đó khó có thể xác định lại cách chúng tôi đào tạo các mô hình AI.

Tóm lại, việc tích hợp một công nghệ vào một nhóm công nghệ khác có thể dẫn đến những khả năng mới, trong khi việc sử dụng công nghệ bên ngoài nhóm công nghệ có thể cải thiện khả năng sử dụng và hiệu quả.

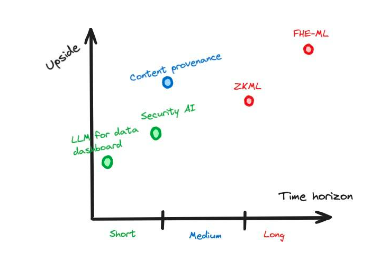

2.6 Đánh giá dự án

Chúng ta có thể ước tính một số lợi ích của một dự án cụ thể dựa trên góc phần tư mà nó rơi vào, bởi vì sự hỗ trợ nội bộ giữa các công nghệ có thể dẫn đến lợi nhuận lớn hơn, nhưng việc ước tính tổng lợi ích được điều chỉnh theo rủi ro của một dự án đòi hỏi chúng ta phải xem xét nhiều yếu tố và rủi ro hơn.

Một yếu tố cần xem xét là liệu dự án đang được xem xét có hữu ích trong bối cảnh Web2, Web3 hay cả hai hay không. Các mô hình AI có khả năng FHE có thể được sử dụng để thay thế các mô hình AI không có khả năng FHE - việc giới thiệu các khả năng FHE rất hữu ích trong cả hai lĩnh vực và quyền riêng tư đều có giá trị trong mọi trường hợp. Tuy nhiên, việc tích hợp các mô hình trí tuệ nhân tạo vào hợp đồng thông minh chỉ có thể được sử dụng trong môi trường Web3.

Như đã đề cập trước đó, việc tích hợp công nghệ giữa lĩnh vực trí tuệ nhân tạo và mã hóa được thực hiện nội bộ hay bên ngoài cũng sẽ quyết định tiềm năng tăng trưởng của dự án.

Chúng tôi cũng phải xem xét khoảng thời gian mà công nghệ này sẽ trưởng thành, điều này sẽ quyết định mọi người phải đợi bao lâu để thu được thành quả.

đầu tư vào các dự án. Điều này có thể được thực hiện bằng cách phân tích tiến độ hiện tại và xác định các điểm nghẽn liên quan đến dự án (xem Phần 2.4).

Hình 7: Một ví dụ giả định minh họa khả năng tăng giá so với khoảng thời gian

2.7 Hiểu các sản phẩm phức tạp

Một số dự án liên quan đến sự kết hợp của bốn loại chúng tôi đã mô tả, thay vì chỉ một loại. Trong trường hợp này, rủi ro và lợi ích gắn liền với dự án có xu hướng nhân lên và thời gian thực hiện dự án sẽ dài hơn.

Ngoài ra, bạn phải xem xét liệu tổng thể dự án có tốt hơn tổng các phần của nó hay không—một dự án chỉ có mỗi thứ một ít thường không đủ để đáp ứng nhu cầu của người dùng cuối. Một cách tiếp cận tập trung thường mang lại những sản phẩm tuyệt vời.

2.7.1 Ví dụ 1: Flock.io

Flock.ioCho phép giữa nhiều máy chủ"sự phân chia"Để huấn luyện một mô hình, không bên nào có quyền truy cập vào tất cả dữ liệu huấn luyện. Vì bạn có thể trực tiếp tham gia đào tạo mô hình nên bạn có thể đóng góp cho mô hình bằng dữ liệu của riêng mình mà không bị rò rỉ bất kỳ dữ liệu nào. Điều này giúp bảo vệ quyền riêng tư của người dùng. Khi ngăn xếp AI (đào tạo mô hình) thay đổi, điều này liên quan đến việc mã hóa trợ giúp AI trong nội bộ.

Ngoài ra, họ sử dụng mã thông báo mật mã để thưởng cho những người tham gia đào tạo mô hình và hợp đồng thông minh nhằm trừng phạt tài chính những người làm gián đoạn quá trình đào tạo. Điều này không làm thay đổi quy trình liên quan đến việc đào tạo mô hình, công nghệ cơ bản vẫn không thay đổi nhưng tất cả các bên cần tuân theo cơ chế cắt giảm trên chuỗi. Đây là một ví dụ về mật mã giúp AI từ bên ngoài.

Quan trọng nhất, mật mã nội bộ giúp AI tạo ra một khả năng mới: các mô hình có thể được đào tạo qua mạng phi tập trung trong khi vẫn giữ dữ liệu ở chế độ riêng tư. Tuy nhiên, tiền điện tử hỗ trợ AI từ bên ngoài không mang lại các khả năng mới vì các token chỉ được sử dụng để khuyến khích người dùng đóng góp cho mạng. Người dùng có thể được bồi thường bằng tiền pháp định và sử dụng các ưu đãi bằng tiền điện tử là giải pháp tốt hơn có thể cải thiện hiệu quả của hệ thống, nhưng nó không đưa ra các khả năng mới.

Hình 8:Flock.ioSơ đồ của ngăn xếp và những thay đổi trong ngăn xếp, trong đó những thay đổi về màu sắc có nghĩa là những thay đổi đã xảy ra bên trong

2.7.2 Ví dụ 2: Robot Rockefeller

Robot RockefellerNó là một robot giao dịch chạy trên dây chuyền. Nó sử dụng AI để quyết định nên thực hiện những giao dịch nào, nhưng vì bản thân các mô hình AI không chạy trên hợp đồng thông minh nên chúng tôi dựa vào nhà cung cấp dịch vụ để chạy mô hình cho chúng tôi, sau đó thông báo cho hợp đồng thông minh về các quyết định của AI và chứng minh họ vào hợp đồng thông minh Không nói dối. Nếu hợp đồng thông minh không kiểm tra xem nhà cung cấp dịch vụ có nói dối hay không thì nhà cung cấp dịch vụ có thể thay mặt chúng tôi thực hiện các giao dịch có hại. Rockefeller Bot cho phép chúng tôi sử dụng bằng chứng ZK để chứng minh với các hợp đồng thông minh rằng nhà cung cấp dịch vụ không nói dối. Ở đây ZK được dùng để thay đổi ngăn xếp AI. Nhóm AI cần áp dụng công nghệ ZK, nếu không chúng ta không thể sử dụng ZK để chứng minh các quyết định kiểu mẫu về hợp đồng thông minh.

Nhờ công nghệ ZK, kết quả đầu ra của mô hình AI có thể được kiểm chứng và truy vấn từ chuỗi khối, nghĩa là mô hình AI được sử dụng bên trong ngăn xếp tiền điện tử. Trong trường hợp này, chúng tôi sử dụng mô hình trí tuệ nhân tạo trong hợp đồng thông minh để quyết định các giao dịch và giá cả một cách công bằng. Điều này sẽ không thể thực hiện được nếu không có trí tuệ nhân tạo.

Hình 9: Sơ đồ thay đổi của robot Rockefeller và ngăn xếp. Thay đổi màu có nghĩa là ngăn xếp (được hỗ trợ nội bộ) đã thay đổi

3. Những vấn đề đáng được nghiên cứu sâu hơn

3.1 Trường mã hóa và ngày tận thế deepfake

Ngày 23 tháng Giêng, mộtTin nhắn thoại do AI tạo ra giả mạo là Tổng thống Biden, ngăn cản đảng Dân chủ bỏ phiếu trong cuộc bầu cử sơ bộ năm 2024. Chưa đầy một tuần sau,một nhân viên tài chínhvì đã bắt chước cuộc gọi video deepfake của đồng nghiệp của mình.mất 25 triệu USD. Trong khi đó, trên X (trước đây là Twitter), AI đã làm giả ảnh phản cảm của Taylor SwiftThu hút 45 triệu lượt xem, gây phẫn nộ trên diện rộng. Những sự cố này, đều xảy ra trong hai tháng đầu năm 2024, chỉ là một bản tóm tắt ngắn gọn về những tác động tai hại khác nhau mà deepfake đang gây ra đối với chính trị, tài chính và mạng xã hội.

3.1.1 Chúng trở thành vấn đề như thế nào?

Hình ảnh giả mạo không có gì mới. Năm 1917, tạp chí The Strand công bố những bức ảnh chụp những mảnh giấy phức tạp được thiết kế trông giống như những nàng tiên; nhiều người coi những bức ảnh này là bằng chứng cho sự tồn tại của các thế lực siêu nhiên.

Hình 10: Một trong những bức ảnh “Nàng tiên xứ Cottingley”. Người sáng tạo Sherlock Holmes, Sir Arthur Conan Doyle đã trích dẫn những hình ảnh giả mạo là bằng chứng về hiện tượng huyền bí.

Theo thời gian, việc làm hàng giả trở nên dễ dàng và rẻ hơn, làm tăng đáng kể tốc độ lan truyền thông tin sai lệch. Ví dụ, trong cuộc bầu cử tổng thống Hoa Kỳ năm 2004, một bức ảnh được chỉnh sửa cho thấy ứng cử viên Đảng Dân chủ John Kerry tham dự một cuộc biểu tình với Jane Fonda, một nhà hoạt động gây tranh cãi ở Mỹ. Trong khi Nàng tiên Cottingley yêu cầu sự sắp xếp phức tạp, sử dụng các tấm bìa cứng cắt hình ảnh từ sách dành cho trẻ em, thì việc giả mạo này là một nhiệm vụ đơn giản được thực hiện bằng Photoshop.

Hình 11:Cái nàyBức ảnh chụp John Kerry đứng chung sân khấu với Jane Fonda tại một cuộc biểu tình phản đối Chiến tranh Việt Nam. Sau đó người ta phát hiện ra rằng đó là một bức ảnh giả, được tạo ra bằng cách kết hợp hai hình ảnh hiện có bằng Photoshop.

Tuy nhiên, khi chúng tôi biết cách phát hiện dấu hiệu chỉnh sửa, rủi ro do ảnh giả gây ra đã giảm đi. hiện hữuChàng trai du lịchTrong trường hợp này, những người nghiệp dư có thể xác định xem một hình ảnh đã được chỉnh sửa hay chưa bằng cách quan sát sự không nhất quán về cân bằng trắng giữa các vật thể khác nhau trong cảnh. Đây là sản phẩm của việc nâng cao nhận thức của công chúng về thông tin sai lệch; mọi người đã học cách nhận thấy các dấu hiệu chỉnh sửa hình ảnh. Photoshop” Từ này đã trở thành một thuật ngữ phổ biến: các dấu hiệu cho thấy một hình ảnh đã bị giả mạo đã được công nhận rộng rãi và bằng chứng chụp ảnh không còn được coi là không thể sai lầm.

3.1.1.1 Sự giả mạo sâu sắc giúp việc làm giả dễ dàng hơn, rẻ hơn và chân thực hơn

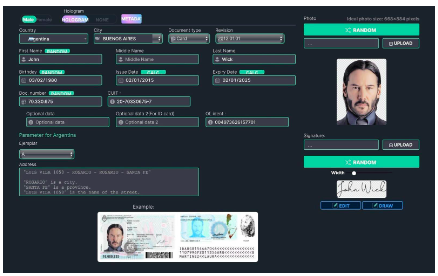

Trước đây, tài liệu giả mạo rất dễ bị phát hiện bằng mắt thường, nhưng công nghệ deepfake đã giúp việc tạo ra những hình ảnh gần như không thể phân biệt được với ảnh thật một cách dễ dàng và rẻ tiền. Ví dụ: trang web OnlyFake sử dụng công nghệ deepfake để tạo ảnh ID giả thực tế trong vài phút chỉ với 15 đô la. Những bức ảnh này được sử dụng để vượt qua OKX, biện pháp bảo vệ chống gian lận của sàn giao dịch tiền điện tử được gọi là Biết khách hàng của bạn"(KYC). Trong trường hợp của OKX, những ID giả mạo sâu này đã đánh lừa nhân viên của họ, những người được đào tạo để phát hiện các hình ảnh giả mạo và giả mạo sâu. Điều này nhấn mạnh rằng gian lận dựa trên deepfake không còn có thể bị phát hiện bằng mắt thường, ngay cả đối với các chuyên gia.

Sự phụ thuộc vào bằng chứng video đã tăng lên khi hình ảnh được làm giả sâu, nhưng các bằng chứng sâu sẽ sớm làm suy yếu nghiêm trọng bằng chứng video. Một nhà nghiên cứu của Đại học Texas tại Dallas sử dụng công cụ hoán đổi khuôn mặt deepfake miễn phí, bỏ qua thành côngChức năng xác minh danh tính do nhà cung cấp KYC triển khai. Đây là một cải tiến lớn – trước đây, việc tạo ra video chất lượng rất tốn kém và mất thời gian.

Vào năm 2019, ai đó phải mất hai tuần và 552 đô la đểđể tạo video deepfake dài 38 giây về Mark Zuckerberg, video cũng sẽ có những sai sót rõ ràng về mặt hình ảnh. Ngày nay, chúng ta có thể tạo video deepfake chân thực miễn phí trong vài phút.

Hình 12: Bảng điều khiển OnlyFake có thể tạo CMND giả trong vài phút

3.1.1.2 Tại sao video lại quan trọng đến vậy

Trước sự ra đời của công nghệ deepfake,Video từng là bằng chứng đáng tin cậy. Không giống như hình ảnh, vốn dễ bị giả mạo, video trước đây rất khó giả mạo và do đó được công nhận là bằng chứng đáng tin cậy trước tòa. Điều này làm cho video deepfake trở nên đặc biệt nguy hiểm.

Đồng thời, sự xuất hiện của deepfake cũng có thể dẫn đến việc từ chối các video thật và Hoa Kỳcủa Tổng thống Bidenmột đoạn vănVideo bị gọi nhầm là deepfake. Các nhà phê bình lấy đôi mắt không chớp và sự khác biệt về ánh sáng của Biden làm bằng chứng, và những tuyên bố đó đã bị bác bỏ. Điều này dẫn đến một vấn đề - sự giả mạo sâu sắc không chỉ làm cho đồ giả trông thật mà còn làm cho đồ thật trông giả, càng làm mờ ranh giới giữa thực tế và hư cấu, đồng thời khiến việc giải trình trở nên khó khăn hơn.

Deepfakes cho phép quảng cáo được nhắm mục tiêu trên quy mô lớn. Chúng ta có thể sớm thấy một YouTube khác nơi những gì được nói, ai được nói và nơi được nói đều được cá nhân hóa cho khán giả. Một ví dụ ban đầu làQuảng cáo được bản địa hóa cho Zomato, quảng cáo có cảnh nam diễn viên Hrithik Roshan gọi đồ ăn từ một nhà hàng nổi tiếng trong thành phố của người xem. Zomato đã tạo các quảng cáo deepfake khác nhau dựa trên vị trí GPS khác nhau của người xem, giới thiệu nội dung về các nhà hàng ở vị trí của người xem.

3.1.2 Các giải pháp hiện nay còn tồn tại những hạn chế gì?

3.1.2.1 Ý thức

Deepfake ngày nay đủ tiên tiến để đánh lừa ngay cả những chuyên gia được đào tạo bài bản. Điều này cho phép tin tặc bỏ qua các thủ tục xác minh danh tính (KYC/AML) và thậm chí cả sự xem xét của con người. Điều này cho thấy chúng ta không thể phân biệt được ảnh deepfake với ảnh thật bằng mắt thường. Chúng ta không thể bảo vệ khỏi deepfake chỉ bằng cách hoài nghi về hình ảnh: chúng ta cần nhiều công cụ hơn để chống lại sự phổ biến của deepfake.

3.1.2.2 Nền tảng

Các nền tảng truyền thông xã hội không sẵn sàng hạn chế các hành vi deepfake một cách hiệu quả nếu không có áp lực xã hội mạnh mẽ. Ví dụ: Meta cấm các video giả có chứa âm thanh giả nhưng từ chối cấm nội dung video hoàn toàn bịa đặt. Họ đã đi ngược lại lời khuyên của ủy ban giám sát của chính họ và không xóa được một đoạnTổng thống Biden âu yếm cháu gáiVideo deepfake, nội dung hoàn toàn bịa đặt。

3.1.2.3 Chính sách

Chúng ta cần luật giải quyết một cách hiệu quả các rủi ro mới của deepfake mà không hạn chế các mục đích sử dụng ít vấn đề hơn, chẳng hạn như nghệ thuật hoặc giáo dục, không cố gắng lừa dối mọi người. Các sự cố như việc phát tán hình ảnh deepfake của Taylor Swift mà không có sự đồng thuận đã khiến các nhà lập pháp phải thông qua luật chặt chẽ hơn để chống lại những hình ảnh deepfake như vậy. Các thủ tục kiểm duyệt trực tuyến được thắt chặt về mặt pháp lý có thể cần thiết để ứng phó với những trường hợp như vậy, nhưng đề xuất cấm tất cả nội dung do AI tạo ra đã khiến các nhà làm phim và nghệ sĩ kỹ thuật số lo ngại rằng điều đó sẽ hạn chế công việc của họ một cách không công bằng. Tìm được sự cân bằng phù hợp là điều quan trọng, nếu không những ứng dụng sáng tạo hợp pháp đó sẽ bị bóp nghẹt.

Bằng cách thúc đẩy các nhà lập pháp nâng cao rào cản gia nhập để đào tạo những mô hình mạnh mẽ, Big Tech có thể đảm bảo sự độc quyền về AI của mình. Điều này có thể dẫn đến sự tập trung quyền lực không thể đảo ngược vào tay một số công ty – ví dụ như khi nói đến trí tuệ nhân tạoSắc lệnh 14110Chúng tôi khuyến nghị nên áp dụng các yêu cầu nghiêm ngặt đối với các công ty có sức mạnh tính toán lớn.

Hình 13: Phó Tổng thống Mỹ Kamala Harris vỗ tay khi Tổng thống Mỹ Joe Biden ký sắc lệnh hành pháp đầu tiên của Mỹ về trí tuệ nhân tạo

3.1.2.4 Công nghệ

Xây dựng các rào chắn trực tiếp vào các mô hình AI để ngăn chặn hành vi lạm dụng là tuyến phòng thủ đầu tiên, nhưng những rào chắn nàyliên tục bị phá hủy. Rất khó để xem xét các mô hình AI vì chúng tôi không biết cách sửa đổi hành vi ở chiều cao hơn bằng cách sử dụng các công cụ cấp thấp hiện có. Ngoài ra, các công ty đào tạo mô hình AI có thể sử dụng các rào cản triển khai như một cái cớ để đưa ra sự giám sát và thiên vị không mong muốn vào mô hình của họ. Điều này có vấn đề vì các công ty công nghệ AI lớn không chịu trách nhiệm trước ý chí công chúng - các công ty được tự do tác động đến mô hình của họ để gây bất lợi cho người dùng.

Ngay cả khi việc tạo ra AI mạnh mẽ không tập trung vào tay các công ty không trung thực, vẫn không thể xây dựng được một AI vừa được bảo vệ vừa không thiên vị. Rất khó để các nhà nghiên cứu xác địnhlạm dụng là gì,Do đó, rất khó để xử lý các yêu cầu của người dùng một cách trung lập, cân bằng đồng thời ngăn chặn hành vi lạm dụng. Nếu chúng ta không thể định nghĩa lạm dụng, thì có vẻ cần phải giảm bớt mức độ nghiêm ngặt của các biện pháp phòng ngừa, có khả năng khiến lạm dụng xảy ra lần nữa. Vì vậy, không thể cấm hoàn toàn việc lạm dụng các mô hình trí tuệ nhân tạo.

Một giải pháp là phát hiện các deepfake độc hại ngay khi chúng xuất hiện, thay vì ngăn chặn chúng được tạo ra. Tuy nhiên, các mô hình AI phát hiện deepfake như các mô hình được OpenAI triển khaido thiếu chính xác, đang trở thànhlỗi thời. Trong khi các phương pháp phát hiện deepfake ngày càng trở nên tinh vi thì công nghệ được sử dụng để tạo ra deepfake cũng ngày càng tinh vi hơn với tốc độ thậm chí còn nhanh hơn—các máy phát hiện deepfake đang thua cuộc trong cuộc chạy đua vũ trang công nghệ. Điều này gây khó khăn cho việc xác định tin tức deepfake chỉ dựa trên các phương tiện truyền thông. Trí tuệ nhân tạo đủ tiên tiến để tạo ra những thước phim giả chân thực đến mức AI không thể đánh giá độ chính xác của nó.

Công nghệ tạo hình chìm mờ đánh dấu các tác phẩm deepfake một cách kín đáo để chúng tôi có thể xác định chúng ở bất cứ nơi nào chúng xuất hiện. Tuy nhiên, deepfake không phải lúc nào cũng đi kèm hình mờ vì hình mờ phải được thêm vào một cách có chủ ý. Đối với các công ty tự nguyện phân biệt bằng cách dán nhãn cho hình ảnh giả mạo của họ, chẳng hạn như OpenAI, hình mờ là một phương pháp hiệu quả. Nhưng dù sao đi nữa, hình mờ vẫn ổnLoại bỏ hoặc giả mạo bằng các công cụ dễ sử dụng, do đó bỏ qua mọi giải pháp chống giả mạo sâu dựa trên hình mờ. Hình mờ cũng có thể vô tình bị xóa, như hầu hết các nền tảng truyền thông xã hội đều làmTự động xóaChữ ký ảnh.

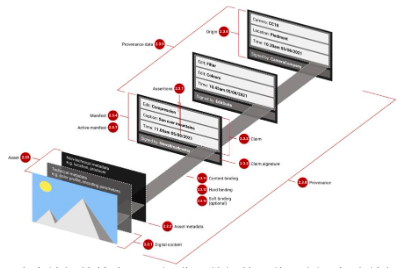

Công nghệ tạo hình mờ deepfake phổ biến nhất làC 2 PA (do Liên minh xác thực và xuất xứ nội dung đề xuất). Nó được thiết kế để ngăn chặn thông tin sai lệch bằng cách theo dõi các nguồn phương tiện và lưu trữ thông tin này trong siêu dữ liệu phương tiện. Công nghệ này được hỗ trợ bởi Microsoft, Google và Adobe, vì vậy C 2 PA có thể sẽ được triển khai trên toàn bộ chuỗi cung ứng nội dung, khiến nó trở nên phổ biến hơn các công nghệ tương tự khác.

Thật không may, C 2 PA có điểm yếu riêng. Vì C 2 PA lưu trữ toàn bộ lịch sử chỉnh sửa của hình ảnh và xác minh từng chỉnh sửa bằng khóa mã hóa được kiểm soát bởi phần mềm chỉnh sửa tuân thủ C 2 PA nên chúng ta phải tin tưởng vào phần mềm chỉnh sửa này. Tuy nhiên, có khả năng là mọi người sẽ chỉ chấp nhận một hình ảnh đã chỉnh sửa vì siêu dữ liệu C 2 PA hợp lệ mà không cân nhắc xem có nên tin tưởng mỗi bên trong chuỗi chỉnh sửa hay không. Vì vậy, nếu bất kỳ phần mềm chỉnh sửa nào bị xâm phạm hoặc có khả năng chỉnh sửa độc hại thì sẽ cóCó thể khiến người khác tin rằng hình ảnh giả mạo hoặc được chỉnh sửa độc hại là hình ảnh thật。

Hình 14: Ví dụ về hình ảnh chứa một loạt chỉnh sửa tuân thủ siêu dữ liệu tiêu chuẩn C2PA. Mỗi bản chỉnh sửa được ký bởi một bên đáng tin cậy khác nhau nhưng chỉ hình ảnh được chỉnh sửa cuối cùng mới được công khai. Nguồn: Ảnh thật và tác phẩm do AI tạo ra: Tiêu chuẩn mới (C 2 PA) sử dụng PKI để hiển thị lịch sử hình ảnh

Ngoài ra, chữ ký mật mã và siêu dữ liệu có trong hình mờ C 2 PACó thể được liên kết với một người dùng hoặc thiết bị cụ thể. Trong một số trường hợp, siêu dữ liệu C 2 PA có thể kết nối tất cả các hình ảnh do máy ảnh của bạn chụp với nhau: nếu chúng tôi biết rằng một hình ảnh nhất định đến từ máy ảnh của ai đó, chúng tôi có thể xác định tất cả các hình ảnh khác từ máy ảnh đó. Điều này giúp phóng viên ẩn danh khi đăng ảnh.

Tất cả các giải pháp tiềm năng sẽ phải đối mặt với một loạt thách thức riêng. Mặc dù những thách thức này rất khác nhau—bao gồm những hạn chế về nhận thức xã hội, những thiếu sót của các công ty công nghệ lớn, khó khăn trong việc thực hiện các chính sách quản lý và những hạn chế về công nghệ của chúng ta.

3.1.3 Lĩnh vực mã hóa có giải quyết được vấn đề này không?

Các mô hình deepfake mã nguồn mở đã bắt đầu được lưu hành. Do đó, người ta có thể lập luận rằng luôn có nhiều cách để lạm dụng hình ảnh người khác bằng cách sử dụng deepfake; ngay cả khi hành vi này bị hình sự hóa, ai đó vẫn sẽ chọn tạo ra nội dung deepfake phi đạo đức. Tuy nhiên, chúng ta có thể giải quyết vấn đề này bằng cách loại bỏ các tác phẩm deepfake độc hại ra khỏi xu hướng phổ biến. Chúng tôi có thể ngăn mọi người nghĩ hình ảnh deepfake là thật và tạo ra các nền tảng hạn chế nội dung deepfake. Phần này sẽ giới thiệu các giải pháp dựa trên mật mã khác nhau cho vấn đề định hướng sai do sự lan truyền của các tác phẩm giả mạo độc hại, đồng thời nêu bật những hạn chế của từng phương pháp.

3.1.3.1 Chứng nhận phần cứng

Máy ảnh được chứng nhận phần cứng nhúng một chứng chỉ duy nhất cho mỗi bức ảnh được chụp, chứng minh rằng bức ảnh đó được chụp bởi máy ảnh đó. Chứng chỉ này được tạo ra bởi chip chống giả mạo, không thể sao chép độc nhất của máy ảnh, đảm bảo tính xác thực của hình ảnh. Các chương trình tương tự có sẵn cho âm thanh và video.

Chứng nhận cho chúng tôi biết rằng hình ảnh được chụp bằng máy ảnh thật, điều đó có nghĩa là chúng tôi thường có thể tin tưởng rằng đó là ảnh của một vật thể thật. Chúng ta có thể gắn nhãn cho hình ảnh mà không cần bằng chứng như vậy. Nhưng phương pháp này không hiệu quả nếu máy ảnh chụp được cảnh giả được thiết kế trông giống như thật—bạn chỉ cần hướng máy ảnh vào một hình ảnh giả. Hiện tại, chúng tôi có thể biết liệu một bức ảnh có được chụp từ màn hình kỹ thuật số hay không bằng cách kiểm tra xem hình ảnh được chụp có bị biến dạng hay không, nhưng những kẻ lừa đảo sẽ tìm cách che giấu những sai sót này (ví dụ: bằng cách sử dụng màn hình tốt hơn hoặc bằng cách hạn chế hiện tượng lóa ống kính). Cuối cùng, ngay cảcông cụ trí tuệ nhân tạoHành vi gian lận này cũng không thể bị phát hiện vì những kẻ lừa đảo có thể tìm mọi cách để tránh tất cả những sự xuyên tạc này.

Xác thực phần cứng sẽ giảm số trường hợp hình ảnh giả mạo được tin cậy, nhưng trong một số trường hợp hiếm hoi, chúng ta vẫn cần các công cụ bổ sung để ngăn chặn sự phát tán của hình ảnh deepfake nếu máy ảnh bị xâm phạm hoặc sử dụng sai mục đích. Như chúng ta đã thảo luận trước đây, việc sử dụng máy ảnh đã được xác thực phần cứng vẫn có thể tạo ra ấn tượng sai lầm rằng nội dung deepfake là hình ảnh thật, chẳng hạn như nếu máy ảnh bị hack hoặc máy ảnh được sử dụng để ghi lại cảnh deepfake trên màn hình máy tính. Để giải quyết vấn đề này, cần có các công cụ khác, chẳng hạn như danh sách đen máy ảnh.

Danh sách đen của máy ảnh sẽ cho phép các nền tảng và ứng dụng truyền thông xã hội gắn cờ hình ảnh từ một máy ảnh cụ thể vì máy ảnh đó được biết là đã tạo ra những hình ảnh sai lệch trong quá khứ. Danh sách đen loại bỏ nhu cầu tiết lộ công khai thông tin có thể được sử dụng để theo dõi camera, chẳng hạn như ID camera, v.v.

Tuy nhiên, không rõ ai là người duy trì danh sách đen máy ảnh, cũng như không rõ ai là người duy trì danh sách đen máy ảnh.KHÔNGBiết ngăn chặn người nhận hối lộ để đưa vào danh sách đen camera của người tố giác.

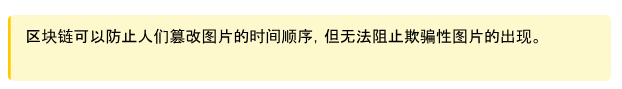

3.1.3.2 Trình tự thời gian hình ảnh dựa trên chuỗi khối

Blockchain là bất biến, vì vậy khi một hình ảnh xuất hiện trên Internet, nó sẽ được thêm vào niên đại được đánh dấu thời gian cùng với siêu dữ liệu bổ sung để dấu thời gian và siêu dữ liệu không thể bị giả mạo. Vì hình ảnh gốc, chưa chỉnh sửa có thể được các bên trung thực lưu trữ bất biến trên blockchain trước khi các chỉnh sửa độc hại lan rộng, nên việc truy cập vào bản ghi đó sẽ cho phép chúng tôi xác định các chỉnh sửa độc hại và xác minh nguồn gốc. Công nghệ này đã được triển khai trên mạng chuỗi khối Polygon như một công cụ kiểm tra thực tế được phát triển với sự hợp tác của Fox NewsVerifymột phần của.

Hình 15: Giao diện người dùng của công cụ Xác minh dựa trên blockchain của Fox. Tác phẩm nghệ thuật có thể được tìm thấy bằng URL. Nhận và hiển thị nguồn gốc, băm giao dịch, chữ ký, dấu thời gian và siêu dữ liệu khác từ chuỗi khối Polygon

3.1.3.3 Nhận dạng số

Nếu deepfake làm suy yếu niềm tin của chúng ta vào những hình ảnh và video chưa được xác minh thì các nguồn đáng tin cậy có thể trở thành cách duy nhất để tránh thông tin sai lệch. Chúng tôi đã dựa vào các nguồn truyền thông đáng tin cậy để xác minh thông tin vì họ sử dụng các tiêu chuẩn báo chí, quy trình xác minh tính xác thực và giám sát biên tập để đảm bảo tính chính xác và độ tin cậy của thông tin.

Tuy nhiên, chúng tôi cần một cách để xác minh rằng nội dung chúng tôi thấy trực tuyến đến từ những nguồn mà chúng tôi tin cậy. Đây là nơi dữ liệu được ký bằng mật mã xuất hiện: nó có thể chứng minh về mặt toán học tác giả của một cái gì đó.

Chữ ký được tạo bằng khóa kỹ thuật số và vì khóa được tạo và tạo bởi ví nên chỉ những người sở hữu ví mật mã được đề cập mới biết. Bằng cách này, chúng tôi biết ai là tác giả của dữ liệu - chỉ bằng cách kiểm tra xem chữ ký có tương ứng với khóa duy nhất của chúng tôi trong ví tiền điện tử cá nhân của chúng tôi hay không.

Chúng ta có thể tận dụng ví tiền điện tử để đính kèm chữ ký vào bài đăng của mình một cách liền mạch và thân thiện với người dùng. Nếu bạn sử dụng ví tiền điện tử để đăng nhập vào nền tảng mạng xã hội, bạn có thể tận dụng chức năng của ví để tạo và xác minh chữ ký trên mạng xã hội. Vì vậy, nền tảng sẽ có thể cảnh báo chúng tôi nếu một bài đăng đến từ một nguồn đáng ngờ - nền tảng sẽ sử dụng xác minh chữ ký tự động để gắn cờ thông tin sai lệch.

Ngoài ra, ví được kết nốizk-KYCCơ sở hạ tầng có thể liên kết các ví không xác định với danh tính được xác minh thông qua quy trình KYC mà không ảnh hưởng đến quyền riêng tư và ẩn danh của người dùng. Tuy nhiên, khi deepfake trở nên phức tạp hơn, các quy trình KYC có thể bị bỏ qua, cho phép các tác nhân độc hại tạo danh tính ẩn danh giả. Câu hỏi này có thể được trả lời bởi WorldcoinBằng chứng về danh tính cá nhân"(PoP)Chờ giải pháp đến.

Nhận dạng cá nhân là cơ chế mà WorldCoin sử dụng để xác minh rằng ví của nó thuộc về người thật và mỗi người chỉ được phép có một ví. Để làm điều này, nó sử dụng các thiết bị hình ảnh sinh trắc học (mống mắt)Orbđể xác minh ví. Vì dữ liệu sinh trắc học chưa thể bị làm giả nên việc yêu cầu các tài khoản mạng xã hội phải được liên kết với một ví WorldCoin duy nhất là một cách khả thi để ngăn chặn những kẻ xấu tạo ra nhiều danh tính ẩn danh nhằm che giấu hành vi trực tuyến vô đạo đức của họ - ít nhất là trước tin tặc cho đến khi tìm ra cách thiết bị sinh trắc học giả mạo, nó có thể giải quyết vấn đề KYC giả mạo.

3.1.3.4 Khuyến khích kinh tế

Tác giả có thể bị trừng phạt vì thông tin sai lệch và người dùng có thể được khen thưởng nếu xác định được thông tin sai lệch. Ví dụ,"trái phiếu xác thực"(Trái phiếu xác thực) cho phép các tổ chức truyền thông khẳng định tính chính xác của các ấn phẩm của họ và đối mặt với các hình phạt tài chính đối với thông tin sai lệch. Điều này cung cấp cho các công ty truyền thông này lý do tài chính để đảm bảo tính xác thực của thông tin.

Trái phiếu xác thực sẽ được"thị trường sự thật"Một phần không thể thiếu của thị trường này, các hệ thống khác nhau cạnh tranh để giành được lòng tin của người dùng bằng cách xác minh tính xác thực của nội dung theo cách hiệu quả và mạnh mẽ nhất. Điều này tương tự với các thị trường chứng minh nhưSuccinct NetworkVà=nil Proof Market, nhưng đối với vấn đề xác minh tính xác thực khó khăn hơn.

Chỉ mật mã thôi là chưa đủ. Hợp đồng thông minh có thể đóng vai trò như một phương tiện thực thi các khuyến khích kinh tế cần thiết để làm cho các “thị trường sự thật” này hoạt động, vì vậy công nghệ blockchain có thể đóng vai trò trung tâm trong việc giúp chống lại thông tin sai lệch.

3.1.3.5 Điểm danh tiếng

Chúng ta có thể sử dụng danh tiếng để thể hiện sự đáng tin cậy. Ví dụ: chúng ta có thể xem một người có bao nhiêu người theo dõi trên Twitter để xác định xem liệu chúng ta có nên tin những gì người đó nói hay không. Tuy nhiên, hệ thống danh tiếng nên xem xét thành tích của mỗi tác giả chứ không chỉ mức độ nổi tiếng của họ. Chúng tôi không muốn nhầm lẫn giữa uy tín và sự nổi tiếng.

Chúng tôi không thể cho phép mọi người tạo số lượng danh tính ẩn danh không giới hạn, nếu không họ có thể từ bỏ danh tính của mình để thiết lập lại uy tín xã hội khi danh tiếng của họ bị tổn hại. Điều này yêu cầu chúng tôi sử dụng danh tính kỹ thuật số không thể sao chép được, như đã giải thích ở phần trước.

Chúng ta cũng có thể sử dụng"thị trường sự thật"Và"Chứng nhận phần cứng"bằng chứng trong việc xác định danh tiếng của một người, vì đây là những phương pháp đáng tin cậy để theo dõi hồ sơ thực sự của họ. Hệ thống danh tiếng là đỉnh cao của tất cả các giải pháp khác được thảo luận cho đến nay và do đó là nhóm phương pháp tiếp cận toàn diện và mạnh mẽ nhất.

Hình 16: Musk gợi ý về việc tạo ra một trang web vào năm 2018 để cung cấp điểm tín nhiệm cho các bài báo, biên tập viên và ấn phẩm.

3.1.4 Giải pháp mã hóa có thể mở rộng được không?

Các giải pháp chuỗi khối được mô tả ở trên yêu cầu chuỗi khối nhanh và có dung lượng lưu trữ cao - nếu không, chúng tôi sẽ không thể kết hợp tất cả hình ảnh vào bản ghi thời gian có thể kiểm chứng trên chuỗi. Điều này càng trở nên quan trọng hơn khi lượng dữ liệu được công bố trực tuyến mỗi ngày tăng theo cấp số nhân. Tuy nhiên, có một sốThuật toán có thểtheo cách vẫn có thể kiểm chứng đượcNén dữ liệu.

Ngoài ra, chữ ký được tạo thông qua xác thực phần cứng không hoạt động trên các phiên bản hình ảnh đã chỉnh sửa: bằng chứng chỉnh sửa phải được tạo bằng zk-SNARK.ZK MicrophoneLà một triển khai chống biên tập cho âm thanh. 4

3.1.5 Deepfake vốn dĩ không xấu

Điều quan trọng là phải thừa nhận rằng không phải tất cả các tác phẩm deepfake đều có hại. Công nghệ này cũng có những công dụng vô hại, như thế nàyVideo do AI tạo ra về Taylor Swift dạy toán. Do chi phí thấp và khả năng tiếp cận của deepfake nên trải nghiệm được cá nhân hóa sẽ được tạo ra. Ví dụ,HeyGenCho phép người dùngGửi tin nhắn cá nhân với khuôn mặt do AI tạo ra trông giống khuôn mặt của bạn. Mô phỏng sâu cũng được dịch thông qua lồng tiếngThu hẹp khoảng cách ngôn ngữ.

3.1.5.1 Các phương pháp kiểm soát và kiếm tiền từ deepfake

Các dịch vụ đối tác AI dựa trên công nghệ deepfake tính phí cao và thiếu trách nhiệm cũng như giám sát. Amouranth, người có ảnh hưởng hàng đầu trên OnlyFans, đã đăng hình đại diện kỹ thuật số của mình để người hâm mộ có thể trò chuyện riêng với cô ấy. Những phần khởi động này có thể hạn chế hoặc thậm chí đóng quyền truy cập, ví dụ:Dịch vụ đồng hành AI có tên Soulmate。

Bằng cách lưu trữ các mô hình AI trên chuỗi, chúng ta có thể sử dụng hợp đồng thông minh để cấp vốn và kiểm soát các mô hình một cách minh bạch. Điều này sẽ đảm bảo rằng người dùng không bao giờ mất quyền truy cập vào mô hình của họ và giúp người tạo mô hình phân phối lợi nhuận giữa những người đóng góp và nhà đầu tư. Tuy nhiên, có những thách thức kỹ thuật. Công nghệ phổ biến nhất để triển khai các mô hình trên chuỗi, zkML (được sử dụng bởi Giza, Modulus Labs và EZKL), sẽ giúp mô hình hoạt độngChậm hơn 1000 lần. Tuy nhiên, nghiên cứu trong lĩnh vực con này vẫn tiếp tục và công nghệ tiếp tục được cải thiện. Ví dụ,HyperOracleĐang cố gắng sử dụngopML,AizelCác giải pháp đang được xây dựng dựa trên Tính toán đa bên (MPC) và Môi trường thực thi tin cậy (TEE).

3.1.6 Tóm tắt chương

Những trò giả mạo sâu tinh vi đang làm xói mòn niềm tin vào chính trị, tài chính và truyền thông xã hội, làm nổi bật"mạng có thể kiểm chứng"Để duy trì sự cần thiết của sự thật và tính toàn vẹn dân chủ.

Deepfake từng là một nỗ lực tốn kém và sử dụng nhiều công nghệ, nhưng những tiến bộ trong trí tuệ nhân tạo đã khiến chúng trở nên dễ dàng tạo ra, làm thay đổi bối cảnh thông tin sai lệch.

4 Nếu bạn quan tâm đến vấn đề này, vui lòng liên hệAlbion.

Lịch sử cho chúng ta biết rằng việc thao túng truyền thông không phải là một thách thức mới, nhưng trí tuệ nhân tạo đã giúp việc tạo ra tin tức giả có sức thuyết phục trở nên dễ dàng và rẻ hơn nên cần có những giải pháp mới.

Gian lận qua video gây ra mối nguy hiểm đặc biệt vì chúng làm tổn hại đến bằng chứng trước đây được coi là đáng tin cậy, khiến xã hội rơi vào tình thế tiến thoái lưỡng nan khi hành vi chân thật có thể bị coi là giả mạo.

Các biện pháp đối phó hiện tại được chia thành các phương pháp tiếp cận nhận thức, nền tảng, chính sách và công nghệ, mỗi biện pháp đều phải đối mặt với những thách thức trong việc chống lại các hành vi deepfake một cách hiệu quả.

Bằng chứng phần cứng và chuỗi khối cung cấp các giải pháp đầy hứa hẹn bằng cách chứng minh nguồn gốc của từng hình ảnh và tạo ra một bản ghi chỉnh sửa minh bạch, không thể thay đổi.

Ví tiền điện tử và zk-KYC tăng cường xác minh và xác thực nội dung trực tuyến, trong khi các hệ thống danh tiếng trên chuỗi và các ưu đãi kinh tế như"trái phiếu xác thực") cung cấp một thị trường cho sự thật.

Trong khi thừa nhận những công dụng tích cực của deepfake, Crypto cũng đề xuất một cách đưa các deepfake có lợi vào danh sách trắng, từ đó tạo ra sự cân bằng giữa đổi mới và tính toàn vẹn.

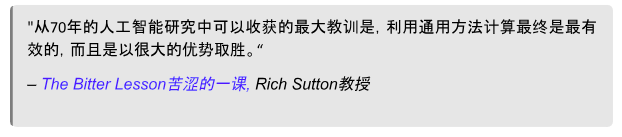

3.2 Một bài học cay đắng

Tuyên bố này là phản trực giác, nhưng nó là sự thật. Cộng đồng AI bác bỏ quan điểm cho rằng các phương pháp tiếp cận tùy chỉnh sẽ kém hiệu quả hơn, nhưng"Một bài học cay đắng"Vẫn áp dụng: sử dụng sức mạnh tính toán cao nhất luôn mang lại kết quả tốt nhất.

Chúng ta phải mở rộng quy mô: nhiều GPU hơn, nhiều trung tâm dữ liệu hơn, nhiều dữ liệu đào tạo hơn.

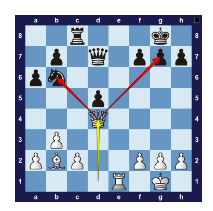

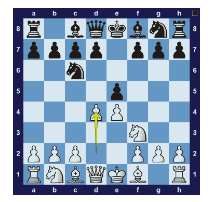

Các nhà nghiên cứu cờ vua trên máy tính đã cố gắng sử dụng kinh nghiệm của những người chơi hàng đầu để xây dựng công cụ cờ vua và đây là một ví dụ về việc các nhà nghiên cứu đã sai. Các chương trình cờ vua đầu tiên sao chép chiến lược khai cuộc của con người (sử dụng"cuốn sách mở đầu"). Các nhà nghiên cứu hy vọng động cơ cờ vua có thể xuất phát từ thế mạnh mà không cần phải tính toán nước đi tốt nhất từ đầu. Chúng cũng chứa nhiều"chẩn đoán chiến thuật"-Chiến thuật được người chơi cờ sử dụng, chẳng hạn như nĩa. Nói một cách đơn giản: các chương trình cờ vua được xây dựng dựa trên những hiểu biết sâu sắc của con người về cách chơi cờ thành công hơn là các phương pháp tính toán chung.

Hình 18: Fork – Hậu tấn công hai quân

Hình 19: Ví dụ về trình tự khai cuộc cờ vua

Năm 1997, DeepBlue của IBM đã kết hợp sức mạnh tính toán khổng lồ với công nghệ dựa trên tìm kiếm để đánh bại nhà vô địch cờ vua thế giới. Mặc dù DeepBlue vượt trội hơn tất cả"thiết kế của con người"động cơ cờ vua, nhưng các nhà nghiên cứu cờ vua tránh xa nó. Họ lập luận rằng thành công của DeepBlue chỉ tồn tại trong thời gian ngắn vì nó không sử dụng chiến lược cờ vua - theo quan điểm của họ, một giải pháp thô thiển. Họ đã sai: Về lâu dài, các giải pháp áp dụng số lượng lớn tính toán cho các vấn đề chung có xu hướng tạo ra kết quả tốt hơn so với các giải pháp tùy chỉnh. Hệ tư tưởng tính toán cao này

sinh sản thành côngCông cụ cờ vây (AlphaGo), công nghệ nhận dạng giọng nói được cải tiến và công nghệ thị giác máy tính đáng tin cậy hơn.

Thành tựu mới nhất trong các phương pháp AI có tính toán cao là ChatGPT của OpenAI. Không giống như những nỗ lực trước đây, OpenAI không cố gắng mã hóa sự hiểu biết của con người về cách hoạt động của ngôn ngữ vào phần mềm. Thay vào đó, mô hình của họ kết hợp lượng dữ liệu khổng lồ từ internet với điện toán khổng lồ. Không giống như các nhà nghiên cứu khác, họ không can thiệp hay nhúng bất kỳ thành kiến nào vào phần mềm. Về lâu dài, các phương pháp hiệu quả nhất sẽ luôn dựa trên các phương pháp có mục đích chung tận dụng khối lượng tính toán lớn. Đây là một sự thật lịch sử; trên thực tế, có lẽ chúng ta có đủ bằng chứng để chứng minh điều này là đúng mãi mãi.

Kết hợp sức mạnh tính toán khổng lồ với lượng dữ liệu khổng lồ là cách tiếp cận tốt nhất về lâu dài và lý do cho điều này là Định luật Moore: Chi phí tính toán sẽ giảm theo cấp số nhân theo thời gian. Trong ngắn hạn, chúng ta có thể không chắc chắn về sự gia tăng đáng kể về băng thông máy tính, điều này có thể khiến các nhà nghiên cứu cố gắng cải thiện kỹ thuật của họ bằng cách nhúng thủ công kiến thức và thuật toán của con người vào phần mềm. Cách tiếp cận này có thể hiệu quả trong một thời gian, nhưng sẽ không thành công về lâu dài: việc đưa kiến thức của con người vào phần mềm cơ bản khiến phần mềm trở nên phức tạp hơn và các mô hình không thể cải thiện khi có thêm sức mạnh tính toán. Điều này làm cho các phương pháp tiếp cận nhân tạo trở nên thiển cận, vì vậy Sutton khuyến nghị chúng ta nên bỏ qua các kỹ thuật nhân tạo và tập trung vào việc áp dụng nhiều sức mạnh tính toán hơn cho các kỹ thuật tính toán nói chung.

Bài học cay đắng có ý nghĩa rất lớn về cách chúng ta nên xây dựng trí tuệ nhân tạo phi tập trung:

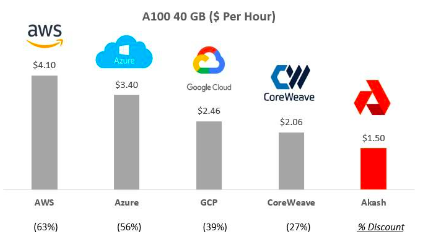

Xây dựng mạng lưới lớn: Các bài học rút ra ở trên nêu bật tính cấp thiết của việc phát triển các mô hình AI lớn và tổng hợp các nguồn lực điện toán khổng lồ để đào tạo chúng. Đây là những bước quan trọng để bước vào lĩnh vực mới của trí tuệ nhân tạo.Akash、GPUNetVàIoNetCác công ty như Alibaba Cloud hướng tới việc cung cấp cơ sở hạ tầng có thể mở rộng.

Hình 20: So sánh giá Akash với các nhà cung cấp khác như Amazon AWS

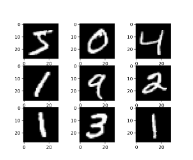

Đổi mới phần cứng: Các phương pháp ZKML đã bị chỉ trích vì chúng chạy chậm hơn 1000 lần so với các phương pháp không phải ZKML. Điều này lặp lại những lời chỉ trích mà mạng lưới thần kinh phải đối mặt. Vào những năm 1990, mạng lưới thần kinh đã cho thấy nhiều hứa hẹn. Mô hình CNN của Yann LeCun, một mạng lưới thần kinh nhỏ, đã có thể phân loại thành công hình ảnh của các chữ số viết tay (xem hình ảnh bên dưới). Đến năm 1998, hơn 10% ngân hàng ở Hoa Kỳ đã sử dụng công nghệ này để đọc séc. Tuy nhiên, các mô hình CNN này không mở rộng quy mô nên sự quan tâm đến các mạng thần kinh này giảm mạnh và các nhà nghiên cứu thị giác máy tính chuyển sang khai thác kiến thức của con người để tạo ra các hệ thống tốt hơn. Vào năm 2012, các nhà nghiên cứu đã phát triển một CNN mới bằng cách tận dụng hiệu quả tính toán của GPU, một phần cứng phổ biến thường được sử dụng để tạo ra đồ họa máy tính (trò chơi, CGI, v.v.). Điều này cho phép chúng đạt được hiệu suất đáng kinh ngạc, vượt xa tất cả các phần cứng khác. mạng này được gọi là AlexNet và nó đã châm ngòi cho cuộc cách mạng học sâu.

Hình 22: Mạng nơ-ron từ những năm 1990 chỉ có thể xử lý hình ảnh kỹ thuật số có độ phân giải thấp.

Hình 23: AlexNet (2012) có thể xử lý các hình ảnh phức tạp và vượt qua tất cả các phương pháp thay thế

Việc nâng cấp công nghệ trí tuệ nhân tạo là tất yếu vì chi phí tính toán luôn ngày càng thấp. Phần cứng tùy chỉnh cho các công nghệ như ZK và FHE sẽ đẩy nhanh tiến độ -IngonyamaCác công ty và học viện đang mở đường. Về lâu dài, chúng tôi sẽ đạt được ZKML quy mô lớn bằng cách áp dụng sức mạnh tính toán lớn hơn và nâng cao hiệu quả. Câu hỏi duy nhất là chúng ta sẽ tận dụng những công nghệ này như thế nào?

Hình 24: Một ví dụ về những cải tiến phần cứng của bộ chuẩn ZK(nguồn)

Chia tỷ lệ dữ liệu: Khi các mô hình AI phát triển về quy mô và độ phức tạp, việc mở rộng quy mô các tập dữ liệu cho phù hợp là điều cần thiết. Nhìn chung, kích thước của tập dữ liệu phải tăng theo cấp số nhân với kích thước mô hình để tránh tình trạng quá khớp và đảm bảo hiệu suất ổn định. Đối với một mô hình có hàng tỷ tham số, điều này thường có nghĩa là quản lý một tập dữ liệu chứa hàng tỷ mã thông báo hoặc ví dụ. Ví dụ: mô hình BERT của Google đã được đào tạo trên toàn bộ Wikipedia tiếng Anh, chứa hơn 2,5 tỷ từ và BooksCorpus, chứa khoảng 800 triệu từ. LLama của Meta được đào tạo trên thư viện 1,4 nghìn tỷ từ. Những con số này nhấn mạnh quy mô của các tập dữ liệu mà chúng ta cần—sẽ còn phải tăng hơn nữa khi các mô hình tiến tới hàng nghìn tỷ tham số. Việc mở rộng này đảm bảo rằng các mô hình nắm bắt được các sắc thái và tính đa dạng của ngôn ngữ con người, vì vậy việc phát triển các bộ dữ liệu lớn, chất lượng cao cũng quan trọng như đổi mới kiến trúc trong chính các mô hình. Các công ty như Giza, Bittensor, Bagel và FractionAI đang giải quyết các nhu cầu cụ thể trong lĩnh vực này (xem Chương 5 để biết chi tiết về các thách thức trong miền dữ liệu như sụp đổ mô hình, tấn công đối nghịch và thách thức đảm bảo chất lượng).

Phát triển các phương pháp tiếp cận chung: Trong lĩnh vực AI phi tập trung, các công nghệ như ZKP và FHE áp dụng các phương pháp tiếp cận dành riêng cho ứng dụng để đạt được hiệu quả tức thì. Các giải pháp điều chỉnh cho một kiến trúc cụ thể có thể cải thiện hiệu suất nhưng có thể hạn chế sự phát triển hệ thống rộng hơn, gây tổn hại đến tính linh hoạt và khả năng mở rộng lâu dài. Thay vào đó, việc tập trung vào một cách tiếp cận chung sẽ cung cấp nền tảng, mặc dù có sự thiếu hiệu quả ban đầu, nhưng có khả năng mở rộng và thích ứng với nhiều ứng dụng cũng như sự phát triển trong tương lai. Khi sức mạnh tính toán tăng lên và chi phí giảm xuống, được thúc đẩy bởi các xu hướng như Định luật Moore, các phương pháp này sẽ phát triển. Việc lựa chọn giữa hiệu quả ngắn hạn và khả năng thích ứng lâu dài là rất quan trọng. Nhấn mạnh một cách tiếp cận chung có thể chuẩn bị cho tương lai của AI phi tập trung như một hệ thống mạnh mẽ, linh hoạt, tận dụng tối đa những tiến bộ trong công nghệ điện toán để đảm bảo sự thành công và phù hợp lâu dài.

3.2.1 Kết luận

Trong giai đoạn đầu phát triển sản phẩm,Chọn cách tiếp cận không bị giới hạn bởi quy môcó thể rất quan trọng. Điều này rất quan trọng đối với cả công ty và nhà nghiên cứu trong việc đánh giá các trường hợp và ý tưởng sử dụng. Tuy nhiên, những bài học khó đã dạy chúng ta rằng về lâu dài, chúng ta nên luôn ghi nhớ ưu tiên cho một cách tiếp cận chung, có thể mở rộng.

Dưới đây là ví dụ về các phương pháp thủ công được thay thế bằng phương pháp phân biệt tự động, có mục đích chung: Trước khi sử dụng các thư viện phân biệt tự động (autodiff) như TensorFlow và PyTorch, độ dốc thường được tính bằng phương pháp phân biệt thủ công hoặc số - một phương pháp không hiệu quả và dễ xảy ra lỗi, và có thể gây ra vấn đề và lãng phí thời gian của các nhà nghiên cứu, không giống như sự khác biệt tự động. Autodiff ngày nay đã trở thành một công cụ không thể thiếu vì thư viện autodiff giúp tăng tốc quá trình thử nghiệm và đơn giản hóa việc phát triển mô hình. Vì vậy, giải pháp chung sẽ thắng - nhưng cho đến khi tính năng tự động phân biệt trở thành một giải pháp hoàn thiện và có thể sử dụng được thì cách tiếp cận thủ công cũ là điều cần thiết để thực hiện nghiên cứu ML.

Dù sao thì, Rich Suttons"Một bài học cay đắng"Hãy cho chúng tôi biết rằng nếu chúng ta có thể tối đa hóa sức mạnh tính toán của trí tuệ nhân tạo, thay vì cố gắng làm cho trí tuệ nhân tạo bắt chước các phương pháp mà con người đã biết, thì trí tuệ nhân tạo sẽ tiến bộ nhanh hơn. Chúng ta phải mở rộng sức mạnh tính toán hiện có, mở rộng dữ liệu, đổi mới phần cứng và phát triển các phương pháp phổ quát — việc áp dụng phương pháp này sẽ có nhiều ý nghĩa đối với lĩnh vực AI phi tập trung. mặc dù"Một bài học cay đắng"Không áp dụng được trong giai đoạn đầu nghiên cứu nhưng có thể luôn đúng về lâu dài.

3.3 AI Agents (tác nhân trí tuệ nhân tạo) sẽ lật đổ Google và Amazon

3.3.1 Vấn đề độc quyền của Google

Những người sáng tạo nội dung trực tuyến thường dựa vào Google để xuất bản nội dung của họ. Đổi lại, nếu Google được phép lập chỉ mục và hiển thị tác phẩm của họ, họ có thể nhận được sự chú ý và doanh thu quảng cáo ổn định. Tuy nhiên, mối quan hệ không đồng đều, Google có sự độc quyền (trên 80% lưu lượng truy cập từ công cụ tìm kiếm) và thị phần mà chính người sáng tạo nội dung cũng không thể sánh bằng. Kết quả là, những người sáng tạo nội dung phụ thuộc rất nhiều vào Google và những gã khổng lồ công nghệ khác để có thu nhập. Một quyết định của Google có thể đánh dấu sự kết thúc hoạt động kinh doanh của một cá nhân.

Việc ra mắt tính năng Đoạn trích nổi bật của Google – hiển thị câu trả lời cho truy vấn của người dùng mà không cần phải nhấp qua trang web gốc – đã nêu bật vấn đề, vì giờ đây bạn có thể lấy được thông tin mà không cần rời khỏi công cụ tìm kiếm. Điều này phá vỡ các quy tắc giúp người sáng tạo nội dung phát triển. Để đổi lấy việc nội dung của họ được Google lập chỉ mục, người sáng tạo nội dung hy vọng rằng trang web của họ sẽ nhận được lưu lượng truy cập giới thiệu và sự chú ý. Thay vào đó, tính năng Đoạn trích nổi bật cho phép Google tóm tắt nội dung đồng thời loại trừ người sáng tạo khỏi lưu lượng truy cập. Bản chất rời rạc của các nhà sản xuất nội dung khiến họ hầu như bất lực trong việc thực hiện hành động tập thể chống lại các quyết định của Google; nếu không có tiếng nói thống nhất, các trang web riêng lẻ sẽ thiếu khả năng thương lượng.

Hình 25: Ví dụ về hàm Đoạn trích nổi bật

Google đã thử nghiệm thêm bằng cách cung cấp danh sách các nguồn trả lời cho truy vấn của người dùng.Ví dụ dưới đâyChứa các nguồn từ The New York Times, Wikipedia, MLB.com, v.v. Vì Google cung cấp câu trả lời trực tiếp nên những trang web này sẽ không nhận được nhiều lưu lượng truy cập.

Hình 26:"từ mạng"Ví dụ về hàm

3.3.2 Vấn đề độc quyền của OpenAI

Tính năng Đoạn trích nổi bật của Google thể hiện một điều đáng lo ngại